强化学习腿足控制和导航:兼顾敏捷和安全

有一些还没有发现的控制和整合上的工作,让机器人不如动物敏捷

- 手脚并用

- 感知结合

神经网络结合本体感受进行修正

放弃多层的方案,直接输出关节的动作,因为上层的控制器不知道底层控制器跟的有多好,底层控制器不知道上层控制器做的有多好,没办法联合优化

可以让机器人的脚和小石头做接触,传统控制是做不到的

鲁棒性

传统控制器在遇到一些雾的情况下怎么办

在sensor degradtion的情况下进行导航

未来RL在腿足机器人领域可能颠覆哪些传统技术?

传统控制(已经)+感知/导航(ongoing)敏捷:RL + goal-reaching, more cases,用了哪一个仿真平台?部署强调“onboard sensing and computation”,采用了哪一家的硬件以及算力大小?

Issaac Gym Orin,有的时候用多个具身智能领域RL的主流技术路线有哪些?如何与大模型衔接?

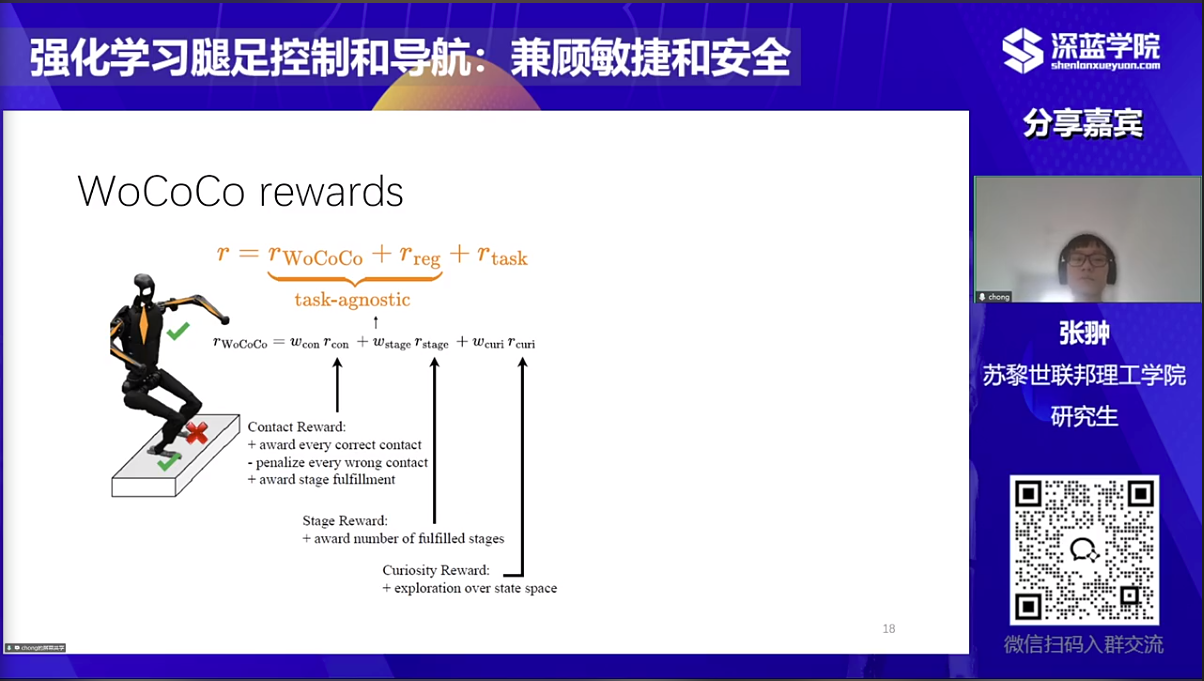

让奖励变得更容易学

VLA加RL,把Policy做很大的模型,后面训练,

大模型做一个planning的工作,control用RL,不需要大模型用一个很高的频率来给一个Plan,因为reach goal的方法还好全身控制的主流技术有哪些,发展方向是如何?

Model-based Learning-based

离线优化一个轨迹,然后去跟踪,

MPC,实时性

还是端到端的RLAgile But Safe (ABS) 框架中,敏捷策略和恢复策略?为什么不能通过一个策略来实现?两个策略的切换触发机制?

两个策略用value funcion做切换用transformer框架生成机器人下一步的位姿(位姿可以离散化),类似语言模型一样,有没有人研究?感觉是不是有前途?

准备将强化学习用在液压挖掘机的自主作业控制上,请问有哪些仿真平台合适?

四四方方 推荐一个入门级的强化腿脚样例,行不行

legged-gym

isaac-lab

mujoco playground

Position goal reaching需要有地图和定位吗

强化学习用于机器人控制方面,有没有比CS285(伯克利)更好的课程?

RL+goal reaching 避障相对于传统避障算法有哪些优劣

多个强化学习策略如何融合?多任务强化学习怎么实现?

多个teacher, 一个student,在H2O框架中,如何利用特权模仿策略去除伪影和不可行运动?

机器狗外加机械臂的操作平台除了物品 pick and place 还有什么任务可以做?

做一些更复杂的任务

把木板搭成一些桥,然后走过这个桥

拖一些比较重的东西

能够拉你的家具

搬运东西的时候做到有一定的规划性,去的时候有一些东西在路上挡着,你可以把它移走然后再做这种降阶模型

DTC

一般是4000个机器人一起并行训练的