混合场景抓取-许可淳

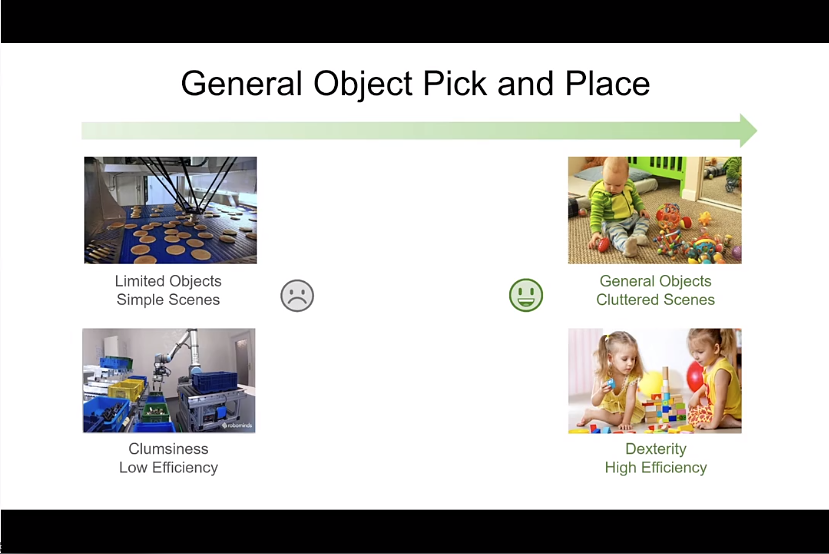

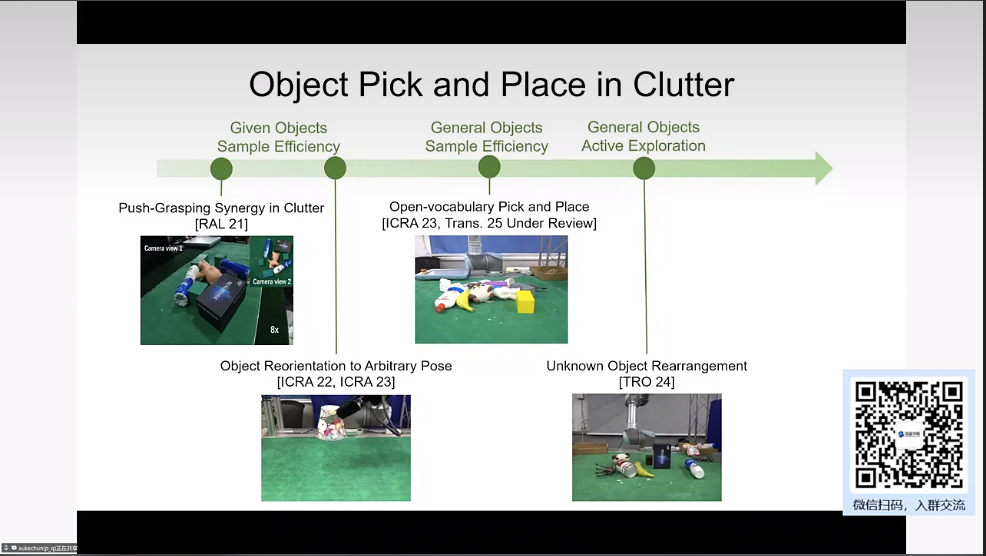

混杂场景下物体的抓取和放置,通用机器人抓放 可能对末端位姿有明确要求

非预编程

- 能够观察物体

- 需要很少的探索

- 能够根据图纸干活

大模型很难从交互中自我学习

模块化的拼接会收到模块化的累计误差的影响

采集数据-每一个场景都采集-可能需要上百种场景,上百万的数据

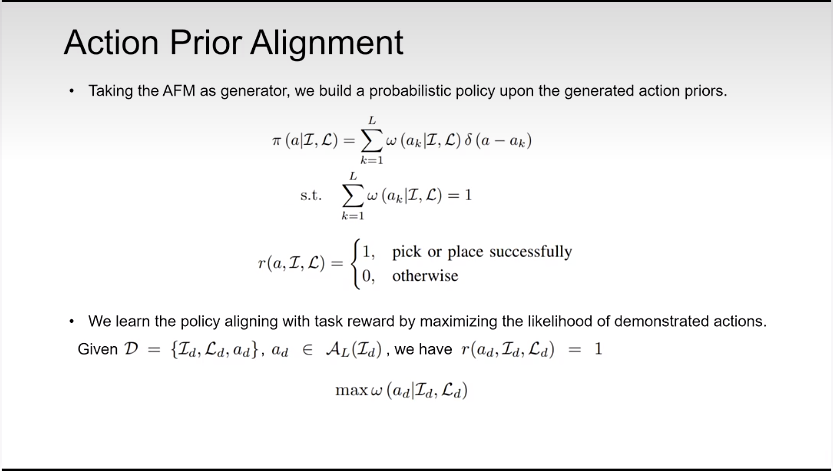

提出了一个Action Foundation Model,给定这样的Action Priors,是不是能够通过少量的学习达到更好的效果

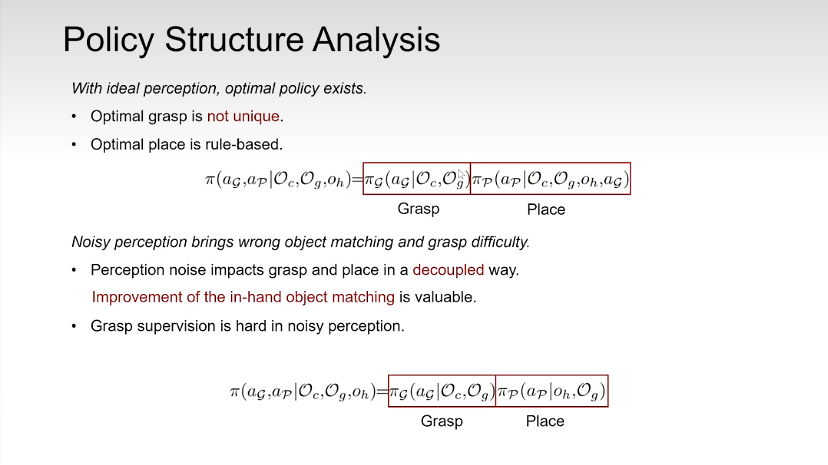

抓和放通过同样的一套网络并且share它们的参数来实现

多峰问题

有很多个动作科学,动作具有多峰分布的特点,

但是采集的时候很难都采集到

弥补place action的多峰分布的问题

Unconditioned Action Prior

把整个问题建模成为一个Uncondition Action Prior的框架

给定目标图像,机器人将目标物体从混杂的场景转移到目标场景

涉及到一定的物体先后专访,buffer,一个长序列的学习问题

Qs:

抓取实验,做实验有没有考虑过更复杂的情况,背景和物体有类似的纹理

抓取是基于Geomoetry来做的,不会影响特别多在第二个工作中,强化学习的作用是什么呢?

长序列的监督会误导整体的策略,因为最优策略并不唯一,而且存在感知噪声,RL扮演的角色是能够在这个基础上带来一些分布,surprivision给一个初始化,RL给一个任务的目标,而不是定死就应该怎么走,在supervision上有一个更好的分布,在泛化性上有更好的提升,主动感知很难去打标签,但是主动感知是goal-based,准确率和置信度是不是有提升Action Prior具体是指哪些?

??????????给了一些比较好的动作先验,发现之前的end to end 的policy并没有用到这样的先验,之前的映射是从什么空间到什么空间的,需要很多数据去学,我们是把学习过程变到了学习1维的数据分布输入是否就是单一摄像头的俯拍视角,还是融合的输入

仿真里是多个视角融合的,有一个从2D出来的VLM怎么映射到3D的一个过程

输入的是多帧的RGBD,然后生成一个完整的点云信息,在单视角下是可以运行的模型对齐部分具体的参数,时长,

3000个各种各样的抓取的,3000个放置的sample去学,时长是4090上7-8个小时,都是用的真实数据,仿真数据直接迁移到真实世界

末端执行器换成灵巧手

对于这样的一个框架而言,需要Action Foundation Module具有一些灵巧手的模态,框架是一个通用的框架,但是数据不是一个数据Action Foundation Model是用的别人训练好的,用Any Grasp是一样的网络

第二个性能提升体现在哪些方面?

最大步数,完成任务的步数,30-40步之间

步数的限制,有一个任务完成的成功率

完成任务的过程中用了多少步数

任务的限制就是在任务步数内,把物体放置到相应的场景,这个就是成功率See Policy需要预训练吗,还是用自己的模型来训练?

光流生成的方法-Raft,生成一些flow,涉及一些dirty-flow表征来表达flow的不确定性,接到后面的网络,就是ResNet或者是MLP这种网络See Policy需要预训练吗,还是内外环策略同时进行

先训练了一个See,后面再训的外环多峰问题是不是可以用Difussion Policy,有测试吗?

可以,Difussion Policy更多是从连续的角度去建模,End to end里面用difussion policy可以学连续的多峰分布,但是这个方法用的是离散的多峰分布,也和用了3d-difusser做了对比最终的输出是什么?

仿真用的是什么,PYbullet,仿真里面数据的输出是末端的位姿,和现在End-toend Policy里面的末端位姿是一样的,CPU配置只会影响你的速度,不会存在run不起来一个Pybullet的情况,基本上一个多个视角的融合会有标定的问题吗?

外参是已知的3070可以吗?

不太够,大概分层的训练的过程,fine-tune训400个episode,内外环几千个episode